Alpaca:一个强的指令跟随模型

Alpaca是一个在7B参数量的LLaMA模型上利用52K指令跟随演示数据微调的模型。在单轮指令跟随数据上评估,Alpaca性能与OpenAI的text0davinci-003一致。

训练方法

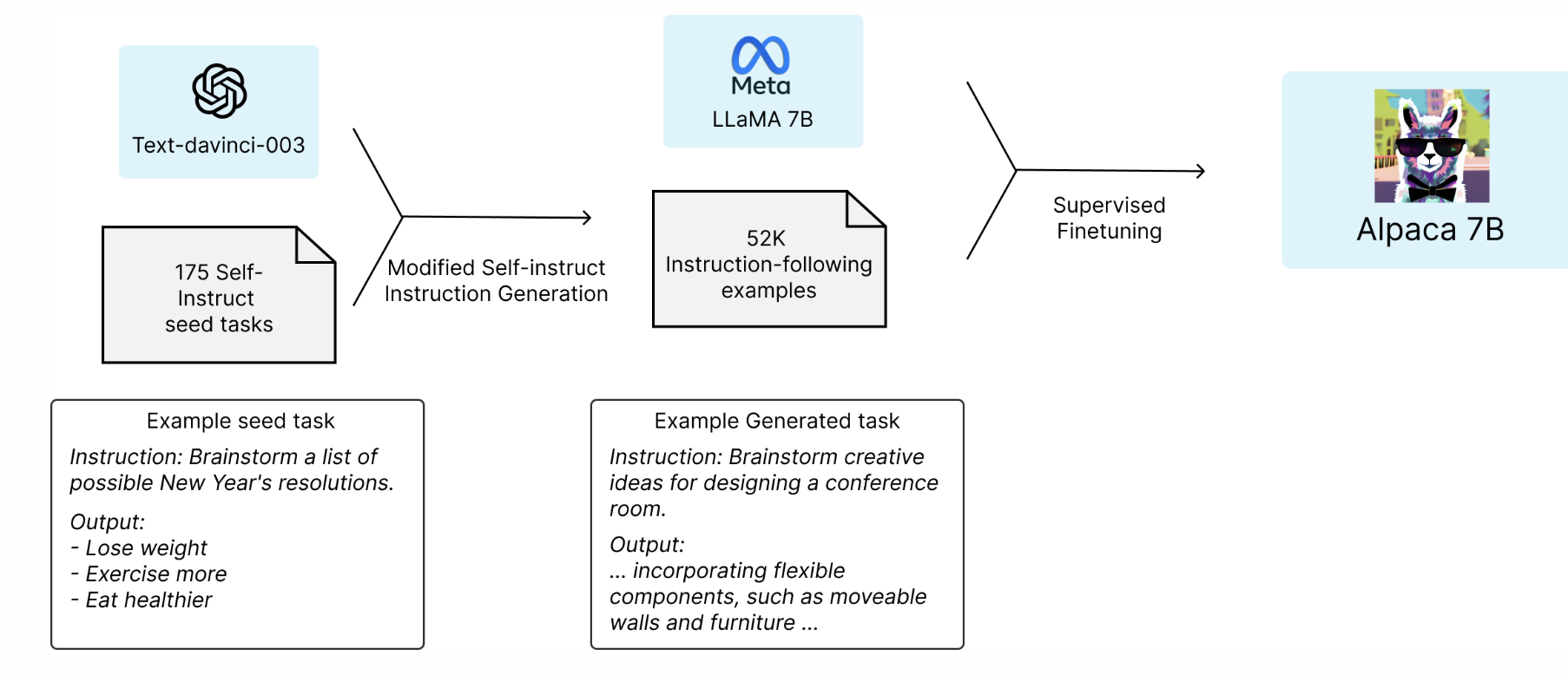

根据self-instruct的方法,利用强的语言模型自动生成指令数据。确切的说,作者们利用175个人手写的指令-输出匹配对作为self-instruct seed set。然后,利用这些数据提示text-davinci-003生成52K指令,可见图1所示。

图1 Alpaca训练概览

评估方法

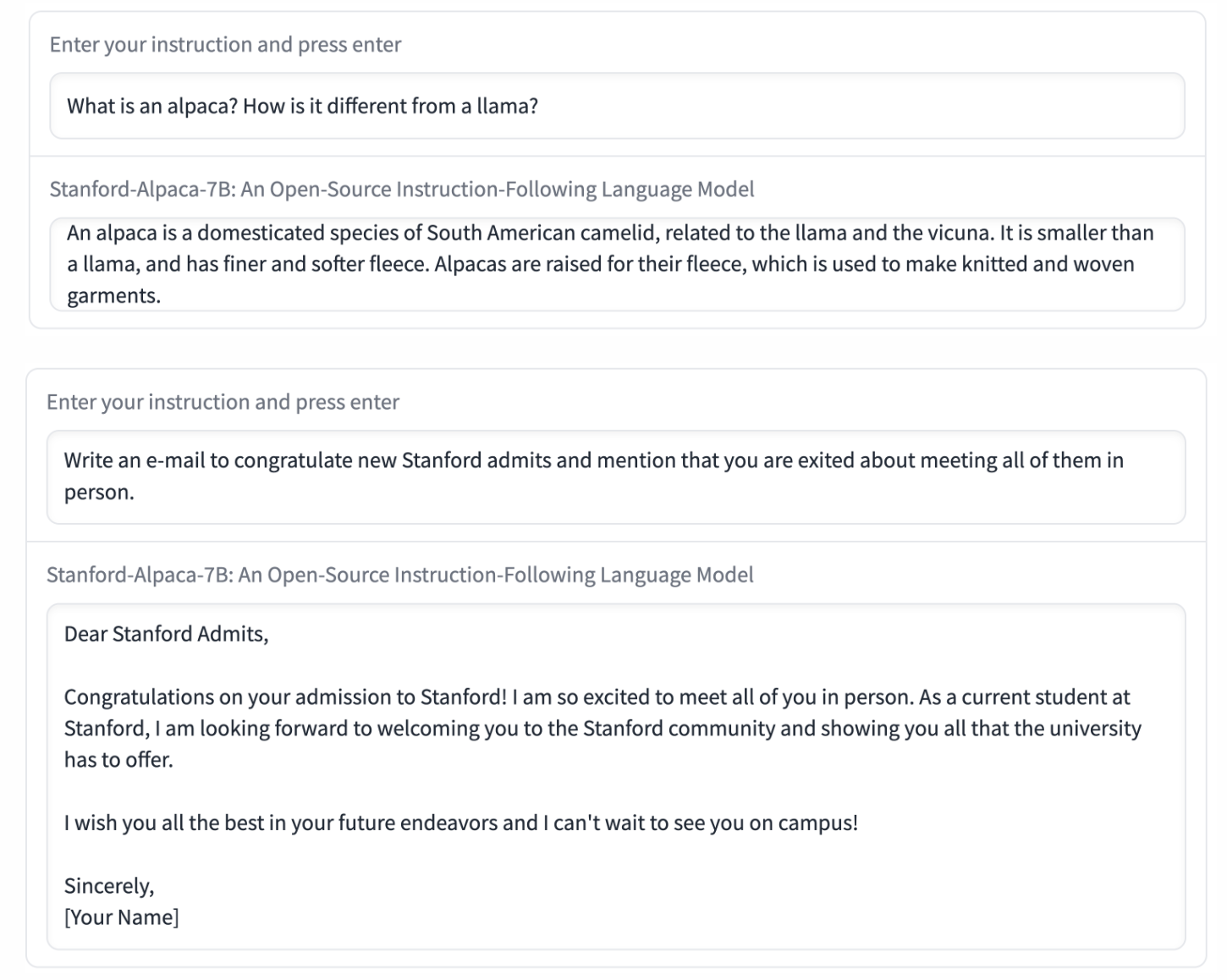

利用来自由5位作者构建的self-instruct评估集合的数据,对模型进行评估。该数据集覆盖的指令有写邮件、社交媒体、以及生产力工具。Alpaca与text-davinci-003模型的输出进行对比的方式评估。除了利用静态数据对模型进行评估,还对模型进行了交互性的测试。

图2 Alpaca交互性测试样例

引用方法

请参考:

li,wanye. "Alpaca:一个强的指令跟随模型". wyli'Blog (Apr 2024). https://www.robotech.ink/index.php/archives/436.html

或BibTex方式引用:

@online{eaiStar-436,

title={Alpaca:一个强的指令跟随模型},

author={li,wanye},

year={2024},

month={Apr},

url="https://www.robotech.ink/index.php/archives/436.html"

}

CC版权: 本篇博文采用《CC 协议》,转载必须注明作者和本文链接